¿Cómo te verías si fueras el protagonista de tu película favorita? Colocar tu rostro en cualquier escena de una película jamás había sido tan sencillo y ahora es posible gracias a muchísimas aplicaciones gratuitas en el mercado. A pesar de que ese video es inofensivo… ¿Cuáles son las implicaciones legales del alcance que puede tener esta tecnología en las manos equivocadas?

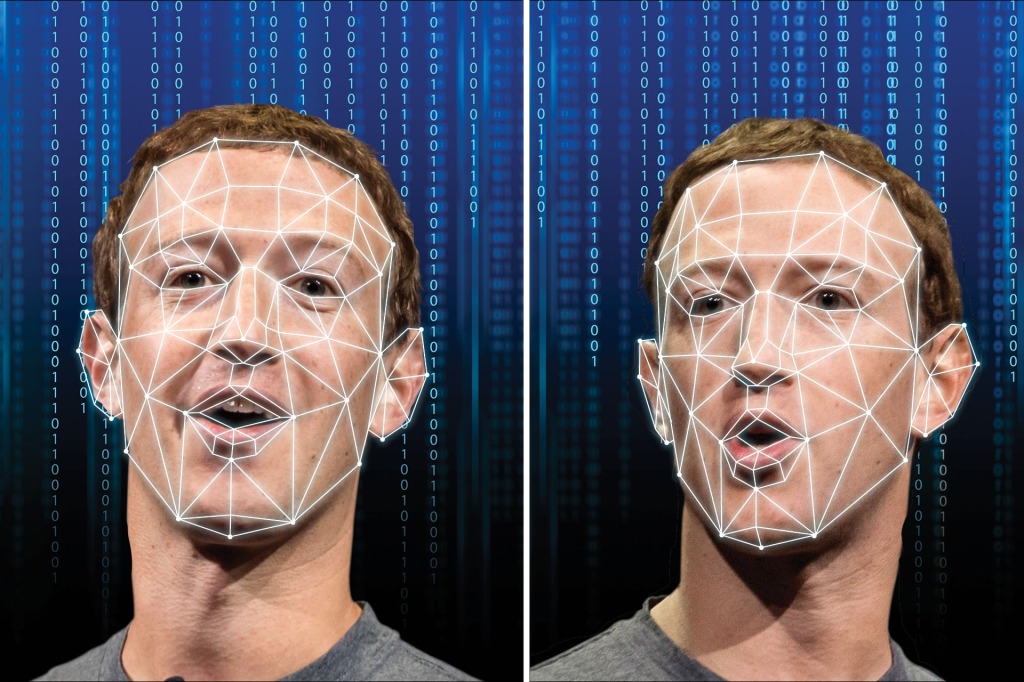

El término deepfake se refiere a videos, imágenes o audios generados mediante un modelo de inteligencia artificial llamado “deep learning” y algoritmos de aprendizaje automático que facilitan la manipulación y creación de contenido multimedia falso, pero altamente realista. Esta práctica fue popularizada recientemente a través de su uso para entretenimiento, pues permite a los usuarios sobreponer sus caras en videos, escenas de películas, e incluso utilizar la voz de alguno de sus artistas favoritos para decir una frase en específico o cantar una canción popular.

Aún más impactante es el uso de la inteligencia artificial que ha estado detrás de la generación de un gran número de las imágenes virales que han sacudido al internet en los últimos meses. Algunos de sus ejemplos más populares fueron aquella imagen del Papa Francisco con una lujosa chamarra de la marca Balenciaga y la aparición de Donald Trump en la popular serie Breaking Bad. Ambos ejemplos fueron creados de manera inofensiva, pero subestimar el poder de los deepfakes es un riesgo altamente costoso.

Imaginemos pues, periodos de elecciones en los que —si bien ya suelen estar acompañados por un gran número de noticias falsas—, estén ahora también inundados de imágenes y videos ficticios tan reales que resulte imposible discernir entre lo verdadero y lo falso. Las implicaciones de esta práctica no sólo se propagan en la esfera pública. Basta imaginarnos lo que podría significar que se sobreponga nuestro rostro en un video o imagen cometiendo un acto delictivo o incluso participando en un video pornográfico para dimensionar la magnitud de las consecuencias de los deepfakes.

Lo anterior no son simples hipótesis, sino escenarios que ya han comenzado a ocurrir alrededor del mundo. Tal fue el caso de Gabón y Malasia, en donde deepfakes fueron vinculados a un presunto encubrimiento del gobierno relacionado con un intento de golpe militar y una campaña de difamación política que amenaza con encarcelar a un político de alto perfil. Por otro lado, este artículo estaría incompleto sin mencionar que, de hecho, el término deepfake fue acuñado por usuarios de Reddit en el 2017, quienes fueron pioneros de esta tecnología a través de la lamentable manipulación de material pornográfico ya existente para sobreponer rostros diferentes a aquellos que participaron originalmente —y que representa el 96% del total de los videos deepfake existentes.

Sin embargo, ¿cuáles son las implicaciones legales de esta nueva aplicación de la inteligencia artificial? El tema en cuestión puede separarse en tres vertientes de acuerdo a las repercusiones que puede ocasionar en sus tres esferas de uso más frecuentes: personal, política y comercial. A continuación se abordará el tema desde la esfera personal.

El video “This is not Morgan Freeman” (Este no es Morgan Freeman) es un ejemplo ideal de lo sencillo que es para esta aplicación de la inteligencia artificial poner palabras en la boca de otra persona. A pesar de que el video creado fue con propósito informativo y no incurrió en ninguna afectación al honor del actor… ¿Qué pasaría si se utilizara inteligencia artificial para generar una imagen o video en el que parezcas estar haciendo algo que dañe tu reputación?

La Ley Federal de Derecho de Autor (LFDA) en su artículo 87 protege el derecho a la propia imagen al expresar que el retrato de una persona solo puede ser usado o publicado con el consentimiento de su titular, al tiempo que contempla en su artículo 216 Bis la posibilidad de recibir una indemnización por la vulneración a ese derecho. Sin embargo, la Real Academia Española (RAE) define la palabra retrato como una pintura, efigie, o fotografía de una persona, por lo que el artículo 87 no acoge en su literalidad la posibilidad de que el retrato de la persona que está siendo utilizado sin su consentimiento no sea una fotografía literal, sino una fotografía artificialmente creada con el rostro de la misma.

Al respecto, la Suprema Corte de Justicia de la Nación (SCJN) se ha pronunciado en el Amparo Directo 7/2022 para reconocer el derecho fundamental a la propia imagen como un derecho humano y fundamental vinculado al principio de dignidad como un valor moral esencial. Además, se le reconoció como un derecho de la personalidad derivado de la dignidad humana que no solo protege la autonomía de las personas para decidir libremente la imagen con la que quieren mostrarse frente a la sociedad —una de cuyas manifestaciones es la “apariencia física”—, sino que además, otorga poder de decisión sobre las representaciones o manifestaciones gráficas de esa imagen y los usos o finalidades que se pretenda dar a estas (SCJN, 2022). De este modo, el derecho a la propia imagen tutela la proyección exterior y concreta de la persona al reconocer la afectación que esta pudiese tener en su honra y vida privada, al tiempo que dota a la persona de la facultad para protegerse de intromisiones ilegítimas a través de la facultad de decidir sobre el uso de su imagen.

La SCJN expresa que, por ende, en el artículo 87 de la LFDA debe interpretarse el vocablo “retrato” no como “fotografía”, sino como si este fuese “imagen” —que ante la RAE engloba la figura, representación, semejanza y apariencia de algo. Este criterio de interpretación abre entonces la puerta para otorgar a la persona la facultad de utilizar el artículo mencionado en caso de ser víctima de una imagen deepfake que le retrate, además de exigir la indemnización establecida en el artículo 216 Bis de dicho instrumento.

Asimismo, cuando la imagen haya ocasionado perjuicio en su honor, reputación y/o vida privada, la ley civil permite que la persona afectada también pueda invocar a la reparación del daño moral, el cual se presume que ocurre cuando se vulnere ilegítimamente la libertad o la integridad física o psíquica de las personas, y se define como la afectación que una persona sufre en sus sentimientos, afectos, creencias, decoro, honor, reputación, vida privada, configuración y aspecto físicos, o bien la consideración que de sí misma tienen los demás.

Por otro lado, el deepfake pornográfico podría considerarse como la peor de las variaciones de esta aplicación de la inteligencia artificial, puesto que involucra contenido explícito de la persona sin su consentimiento y generando el resultado más humillante para su esfera social (Meskys, 2020). Si el video o la imagen que llegase a ser generada fuese de índole sexual, es posible traer a colación el artículo 199 Octies del Código Penal Federal, el cual tipifica los delitos de violación a la intimidad sexual —comúnmente conocido como la Ley Olimpia.

“Artículo 199 Octies.- Comete el delito de violación a la intimidad sexual, aquella persona que divulgue, comparta, distribuya o publique imágenes, videos o audios de contenido íntimo sexual de una persona que tenga la mayoría de edad, sin su consentimiento, su aprobación o su autorización. Así como quien videograbe, audiograbe, fotografíe, imprima o elabore, imágenes, audios o videos con contenido íntimo sexual de una persona sin su consentimiento, sin su aprobación, o sin su autorización.”

La pena por este delito es de tres a seis años de prisión y una multa de quinientas a mil Unidades de Medida y Actualización, y ante el rápido incremento del alcance de la tecnología de inteligencia artificial, es de celebrarse que dicho artículo incluye dentro de las conductas delictivas la acción de elaborar el contenido sexual íntimo. Sin embargo, la aplicación de la Ley Olimpia se ha quedado corta ante los casos de suplantación de identidad con fines pornográficos. “Las víctimas y expertos aseguran que es complejo ubicar, judicializar y sentenciar a quienes roban la identidad en redes sociales, y los alcances más cercanos a la justicia es el cierre de las cuentas falsas como intento para evitar que cometan fraudes a costa de nombres y fotografías de las víctimas.” (Sandoval, 2022)

La pelea contra los deepfakes supone desafíos monumentales con complicadas implicaciones legales. Sería impreciso declarar esta herramienta como rotundamente negativa, pues ha tenido numerosas aplicaciones positivas entre las cuales destacan el fácil doblaje de anuncios de emergencia en idiomas para todo el mundo, y la simulación de voz de personas que la han perdido a causa de enfermedades. Sin embargo, los deepfakes cobran una larga lista de víctimas en las manos equivocadas; aquellas a las que se les roba su identidad toman el primer lugar, pero también incluye a los receptores de esta información errónea.

La falta de regulación de esta tecnología coloca un precio en la reputación de las personas, la confianza de la población, e incluso en nuestra democracia y sistema de justicia. Ya existen proyectos en desarrollo para crear una IA capaz de detectar videos manipulados, como lo es el Deep Fake Detector Challenge, creado por Facebook y Microsoft junto con la Universidad de UC Berkeley. Aún así, es difícil asegurar que el ritmo con el que la tecnología deepfake se fortalece logre ser alcanzado por estos proyectos, o que de lograrlo, se despliegue su accesibilidad en todo el mundo a comparación de la disponibilidad de las herramientas para crear deepfakes. En los Tribunales, un caso con pruebas deepfakes entorpecerían estrepitosamente el juicio e incluso podrían arrinconar a la justicia a la deriva de que existan suficientes herramientas tecnológicas para detectar la falsedad de contenido multimedia altamente realista, o que dichas herramientas estén disponibles en todos los tribunales del país.

La educación y la conciencia pública jugarán un papel fundamental para prevenir que el avance de las tecnologías de inteligencia artificial dañen trascendentalmente la confianza y seguridad de la población. Sin embargo, será crucial que se multipliquen los esfuerzos para desplegar estrategias legales y tecnológicas que impulsen el desarrollo de iniciativas capaces de responder y prevenir los problemas que los deepfakes ya ocasionan en nuestro entorno.

REFERENCIAS

https://cincodias.elpais.com/cincodias/2021/06/08/legal/1623163694_649925.html

https://cincodias.elpais.com/cincodias/2021/06/08/legal/1623163694_649925.html