Una de las herramientas más usadas por los abogados es el famoso “silogismo jurídico”, usado para argumentar en demandas y juicios orales. Dicho utensilio jurídico consta de una premisa mayor, en la cual se expone la figura jurídica como ley o norma; una premisa menor, que es el caso o hechos; y una conclusión, en donde se explica la decisión o el veredicto del ejercicio juntando las dos premisas.

Este tipo de argumentación jurídica es de excelencia ante el convencimiento de los jueces, pues si se usa de manera adecuada, es fácil de inclinar ante una resolución a nuestro favor, pues utiliza la lógica. De hecho, es muy curioso como esta argumentación se asimila bastante a la programación tecnológica. El sistema de programación utiliza la función “What if?”, donde dependiendo de cualquier elección predeterminada, corresponde a una respuesta. Como en una computadora, en las funciones de apagado o reinicio, dependiendo de la elección, terminará en un camino distinto. Sin embargo, ¿qué tiene que ver esto con los juicios o el derecho?

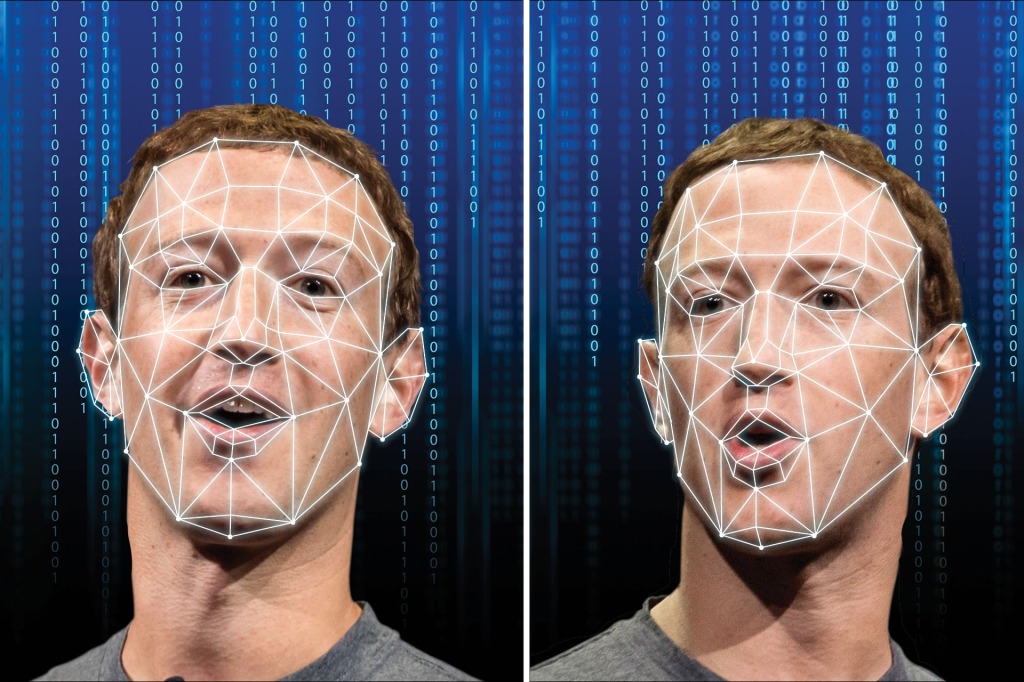

Dentro de ambos sistemas, se encuentran bastantes similitudes, como una base para juzgar el camino que se toma, el hecho que define la decisión y la conclusión con el final. La premisa mayor es lo mismo que la base para juzgar el camino que se toma. La función “What if” sirve como la premisa mayor en donde se narra el hecho y ambos comparten las mismas conclusiones. Se podría decir que son idénticos en funcionalidad, tanto que en diversos países como Estonia o Reino Unido, que comenzaron a utilizar la mezcla de estas funciones para formar juicios empleando IA como abogados y jueces. Estas máquinas como debatientes narran hechos y buscan con rapidez entre sus cargas de conocimientos integradas por documentos, jurisprudencias y la ley como defensa; mientras que los jueces “robots” utilizan directamente los sistemas de “what if” con una carga de conocimiento legal.

Dicha aplicación puede ser buena para cosas simples y rápidas. Sin embargo, la confianza de las personas ante estos sistemas no es plena, debido al estigma de fallas tecnológicas. También es criticable que a pesar de ser funcionales, son costosos y no útiles en casos complejos con requerimiento de visión de derechos humanos, pues es de recordar, que es muy difícil que una máquina los identifique si es que ya está preprogramada para dar una sentencia.

En el lado positivo, estas son tecnologías que avanzan y que probablemente en un futuro nos sorprendan con su efectividad, pero por el momento, ¿qué opinas sobre su continua implementación por parte de abogados y jueces tecnológicos?

Foto de Ilya Pavlov en Unsplash